人工智能(AI)已经成为塑造各行业、经济体,甚至我们日常生活的重要力量。然而,随着技术的不断发展,一个新的前沿正在出现——去中心化人工智能。这一概念虽然仍处于初期阶段,但可能会从根本上改变AI的开发、部署和控制方式。然而,与这一潜力并存的是显著的风险,引发了关于安全、伦理以及创新本质的诸多问题。

传统的AI开发是集中式的。一些科技巨头主导了这个领域,拥有海量的数据和计算能力。他们基于这些宝贵的信息训练出的模型变得越来越强大和精细。然而,这种集中化导致了垄断,令人担忧的数据隐私。

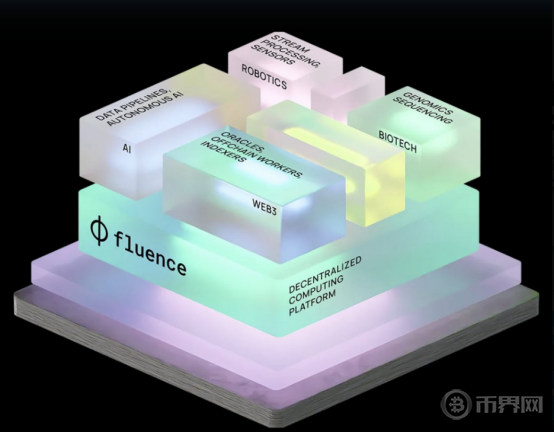

去中心化人工智能颠覆了这一模式。它不再依赖单一实体来开发和控制AI,而是利用区块链技术、联邦学习和边缘计算,将开发和控制分散在一个节点网络中。理论上,这意味着没有任何一个实体拥有所有的权力。数据保持本地化,减少了隐私问题,AI系统也变得更加具有弹性,因为它不依赖于一个中央服务器。

去中心化的方式可以使AI开发民主化。较小的公司甚至个人无需访问传统AI所需的大量资源,也可以贡献和受益于AI系统。这可能会引发一波创新浪潮,因为更多的多样化视角和数据集推动了AI模型的发展。

此外,去中心化人工智能可以增强安全性。分布式网络比集中式系统更难被攻破。如果一个节点受到攻击,其余的网络仍然完好无损,确保AI系统能够继续运行。在医疗、金融和基础设施等关键应用中,这种弹性尤为宝贵,因为AI系统必须对中断具有强大的抵抗力。

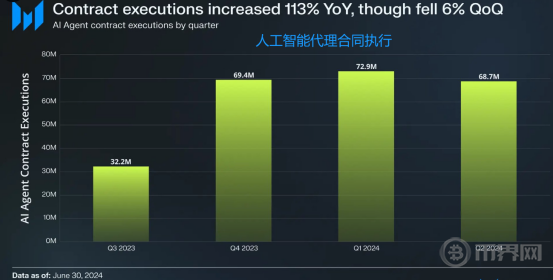

统计数据凸显了人们对去中心化AI日益增长的兴趣。例如,全球联邦学习市场,作为去中心化AI的一个关键组成部分,2020年的市场价值为7800万美元,预计将在2021年至2027年间以12.7%的年均增长率增长,到2027年达到2.38亿美元。此外,区块链在AI中的应用也在快速增长,预计市场规模将从2020年的1.803亿美元增至2025年的9.627亿美元,年均增长率为48.0%。这些数据突显了去中心化AI技术加速发展的势头。

尽管前景广阔,去中心化人工智能并非没有挑战。最显著的问题是信任问题。在去中心化系统中,如何确保每个节点都在为系统的最佳利益行事?区块链技术通过智能合约和共识机制提供了一些解决方案,但这些并非万无一失。特别是在去中心化AI网络尚未成熟且更易受到攻击的早期阶段,不法分子仍可能操纵系统。

另一个挑战是协调去中心化AI系统的复杂性。联邦学习是一种不共享数据的多设备协作训练模型的方法,仍在开发中。它需要仔细协调,以确保来自不同节点的贡献能够有效地整合。这是一个非同寻常的问题,特别是随着节点数量的增加而变得更加复杂。

此外,支持去中心化AI所需的基础设施仍在发展中。物联网设备的数量预计将从2020年的97亿增至2030年的254亿,而这些设备对边缘计算至关重要。然而,将这些设备整合到一个连贯的AI系统中提出了重大的后勤和技术挑战。

伦理问题也是一大考量。去中心化AI可能会使监管或标准的执行变得更加困难。如果AI开发过于分散,追踪并确保符合伦理准则可能变得几乎不可能。这可能导致有偏见或有害的AI模型的泛滥,扩大现有问题而不是解决它们。

去中心化人工智能描绘了一幅未来的诱人愿景,在这个未来,AI开发变得更加民主、安全和创新。然而,要实现这一愿景,需要克服重大的技术、伦理和监管挑战。与任何变革性技术一样,前进的道路不会轻松,但潜在的回报是巨大的。

随着去中心化AI的持续发展,利益相关者——包括政府、企业和民间社会——必须进行深入的对话。

最终,去中心化AI不仅仅是技术上的转变;它也是一种哲学上的转变。它挑战了我们在数字时代关于权力、控制和信任的假设。我们如何应对这一转变将决定AI的未来,并因此决定我们社会的未来。风险很高,但塑造一个更加公平和具有弹性的数字世界的机会就在我们手中。